Permítenos introducirte a ControlNet: una innovadora tecnología de Inteligencia Artificial que genera imágenes ultrarrealistas. Diseñada como una extensión para el sistema avanzado de IA Stable Diffusion, ControlNet es una herramienta revolucionaria para crear imágenes a partir de texto. Descubre cómo funciona esta maravilla tecnológica y adéntrate en el futuro de la generación de imágenes.

Nuestro objetivo es brindarle una explicación fácil de entender sobre ControlNet, junto con una breve reseña de Stable Diffusion. Además, trataremos de desglosar de manera simple cómo esta tecnología crea imágenes de una calidad ultrarrealista. Prepárate para comprender el fascinante mundo de ControlNet de una manera accesible.

Qué es ControlNet

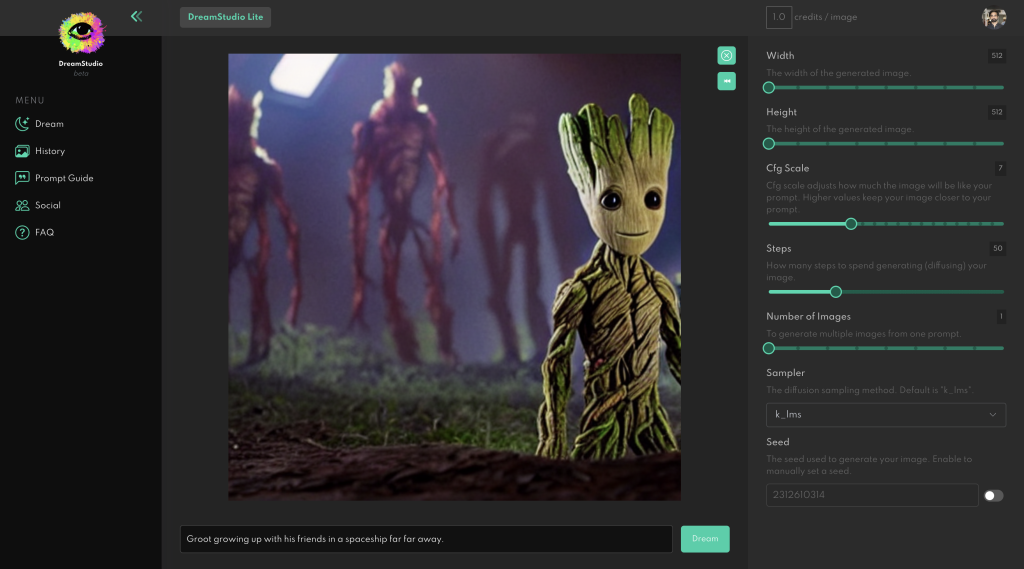

Para comprender ControlNet, es fundamental comprender Stable Diffusion: un motor de inteligencia artificial que genera imágenes a partir de texto. Además, también puede generar imágenes a partir de otras imágenes proporcionadas. Prepárate para descubrir cómo ControlNet mejora aún más esta tecnología.

Desarrollado por la empresa Stability AI y con licencia de código abierto, Stable Diffusion cuenta con un sistema de aprendizaje automático que mejora a medida que se utiliza, afinando continuamente los resultados generados. Prepárate para descubrir cómo ControlNet aprovecha esta tecnología para crear imágenes ultrarrealistas de una calidad asombrosa.

ControlNet es una novedosa arquitectura de redes neuronales diseñadas para «controlar» los grandes modelos de difusión preentrenados y permitirles aceptar condiciones de entrada adicionales. En otras palabras, es un sistema que modifica la salida de datos de Stable Diffusion para ajustarse a ciertas condiciones de control de modelos, lo que permite crear imágenes de una calidad impresionante. Prepárate para descubrir cómo funciona esta tecnología revolucionaria.

En lugar de dejar que Stable Diffusion genere imágenes al azar, ControlNet dirige la creación de imágenes hacia condiciones y modelos específicos. En esencia, ControlNet actúa como plantillas para guiar la creación de Stable Diffusion, lo que resulta en imágenes aún más sorprendentes al permitir un mayor control sobre los resultados. Prepárate para descubrir cómo ControlNet está transformando el mundo de la generación de imágenes.

Cómo funciona ControlNet

ControlNet utiliza su red neuronal para controlar los modelos de difusión generados por Stable Diffusion, que son sistemas que crean imágenes a partir de parámetros específicos. Esta extensión agrega condiciones adicionales a la creación de imágenes.

Cuando solicite una difusión estable que genere una imagen, esta tendrá en cuenta los parámetros que le proporcionen en su comando y generará una imagen al azar en función de ellos. Sin embargo, puede haber gestos y posturas que la IA decida al azar a menos que se especifiquen detalladamente en los parámetros. Prepárate para descubrir cómo ControlNet está realizando la creación de imágenes a un nivel completamente nuevo.

ControlNet entra en juego al agregar condiciones adicionales al modelo de Stable Diffusion para lograr que se parezca a algo específico. Al elegir un modelo de ControlNet, se puede generar una imagen que se asemeje a ese modelo. Por ejemplo, si se elige un modelo de dibujo de una tortuga, Stable Diffusion generará una imagen que se asemeje lo más posible a la tortuga que se le ha especificado. Prepárate para descubrir cómo ControlNet está permitiendo una mayor personalización en la generación de imágenes.

ControlNet no altera el proceso de creación de dibujos de Stable Diffusion, sino que proporciona plantillas para orientar la creación de la imagen y hacer que se parezcan a ellas. Estas plantillas son los modelos preentrenados.

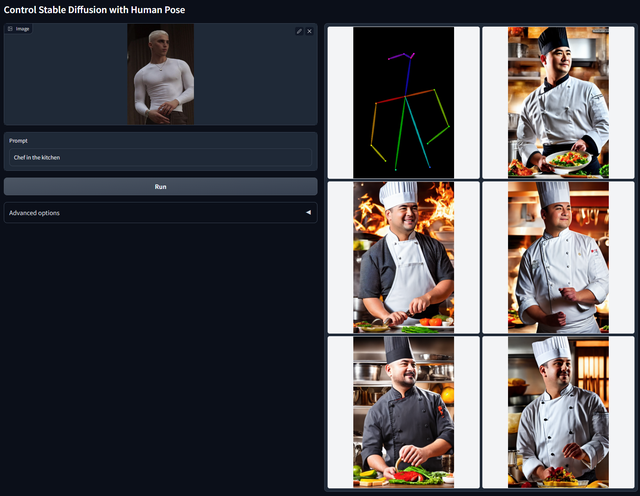

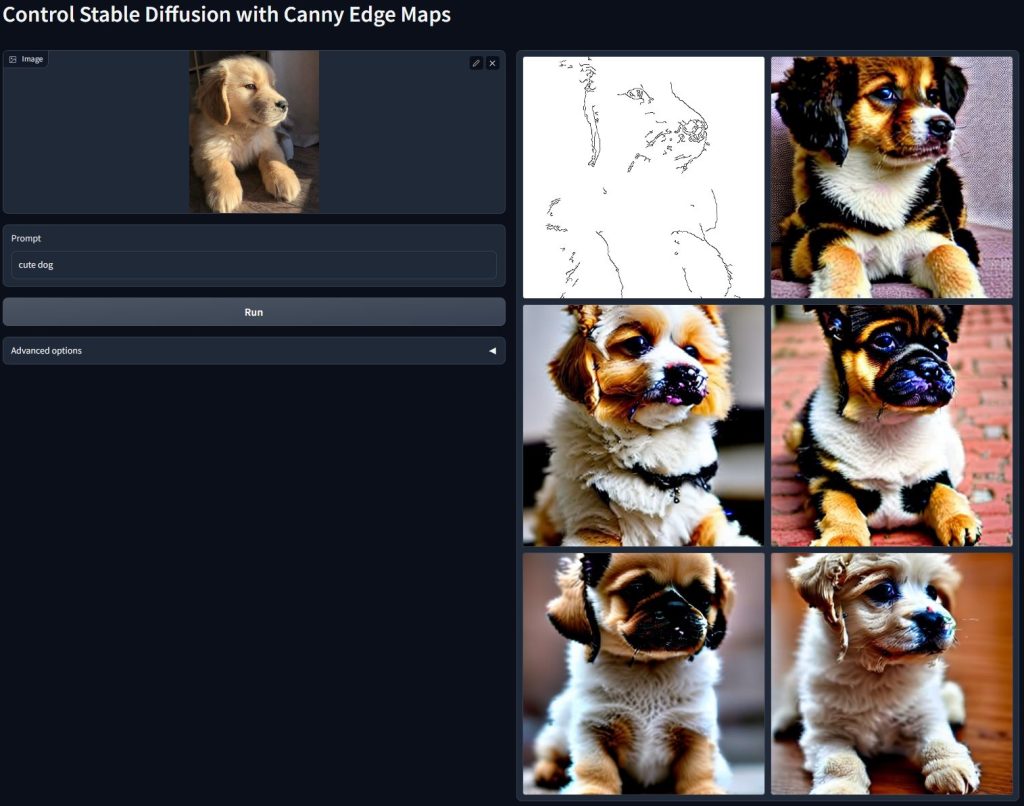

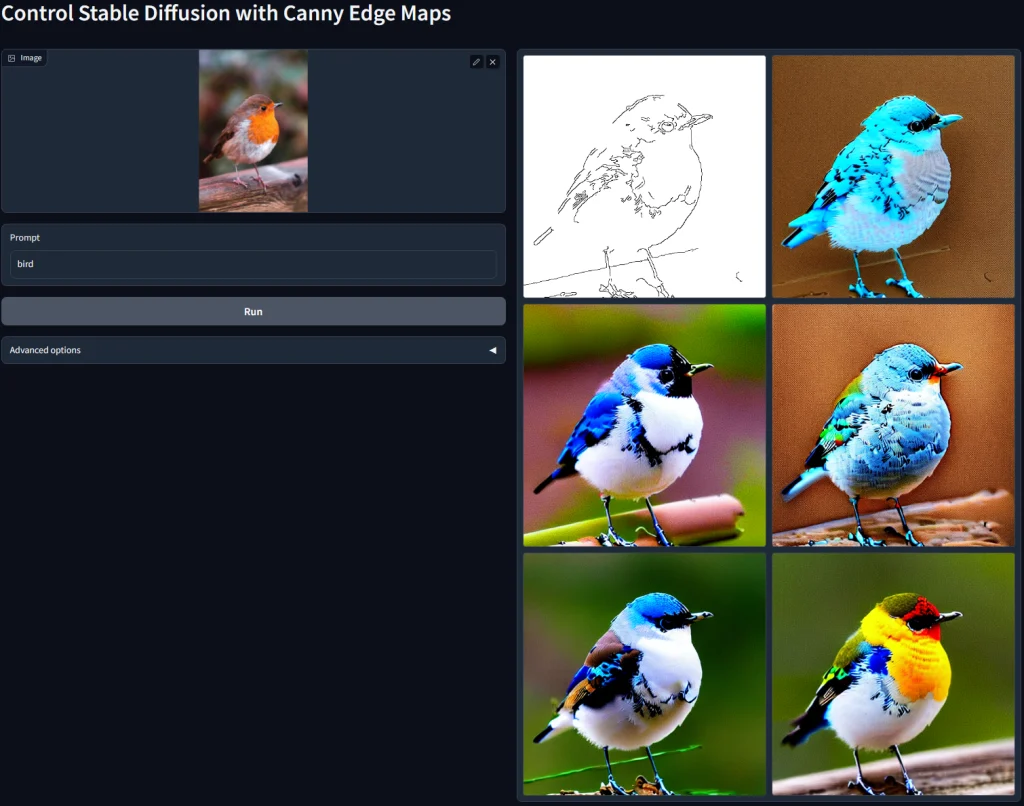

Existen diversas opciones de modelos preentrenados disponibles para ControlNet, cada uno con una función específica. Por ejemplo, uno de estos modelos es Canny Edge, que se encarga de detectar bordes en las imágenes. Otro modelo es Open POSE, que detecta las poses de una imagen de referencia y genera un «esqueleto» de la misma, que a su vez guía la creación de imágenes por parte de Stable Diffusion. Además, existe un modelo denominado User Scribble, que permite al usuario crear un garabato que sirve de base para la generación de una imagen por parte de la IA. En definitiva, estos modelos preentrenados amplían la capacidad de ControlNet y hacen que la creación de imágenes sea aún más precisa y configurada a las necesidades y preferencias del usuario.

Aunque aún no hay una solución fácil para que los usuarios sin conocimientos puedan utilizar esta tecnología, los avances y los modelos se están mostrando en la página de Github de ControlNet. Esto permite a los desarrolladores expertos en IA probar y mejorar la tecnología, y en un futuro cercano, quizás se desarrollen modelos o que sean accesibles para los usuarios comunes. Actualmente, todo se encuentra en fase experimental.